KAIST가 시각 정보를 활용해 지형을 파악하고 스스로 판단해 이동하는 사족보행 로봇 제어기술을 개발했다.

이번 연구는 로봇이 외부 환경을 이해하면서 움직이는 단계로 진입한 성과로 큰 의미를 갖는다.

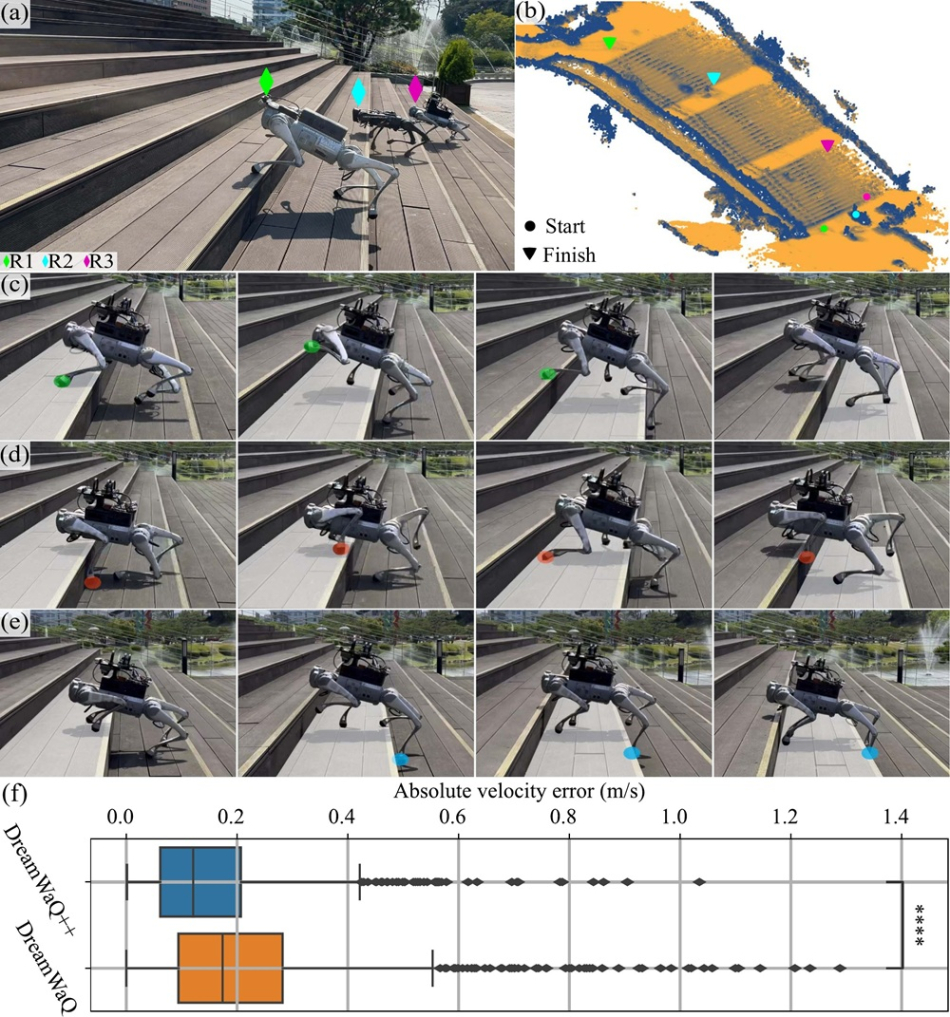

KAIST 전기및전자공학부 명현 교수팀은 교원 창업기업 유로보틱스와 공동연구로 시각기반 보행 제어기술 ‘드림워크++(DreamWaQ++)’를 구현했다.

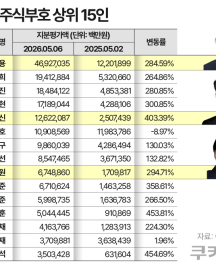

이 기술은 카메라와 라이다 센서를 활용해 주변 지형을 인식하고, 실시간 보행 전략을 조정하는 것이 특징이다.

이는 동물이 시각 정보를 바탕으로 발걸음을 조절하는 방식과 유사하다.

앞서 연구팀이 선보인 드림워크는 관절 엔코더와 관성센서 등 내부 감각만으로 이동하는 블라인드 보행 기술이다.

이 기술은 시야 확보가 어려운 환경에서도 안정적으로 움직일 수 있지만, 장애물과 접촉한 이후에야 대응이 이뤄진다는 제약이 있었다.

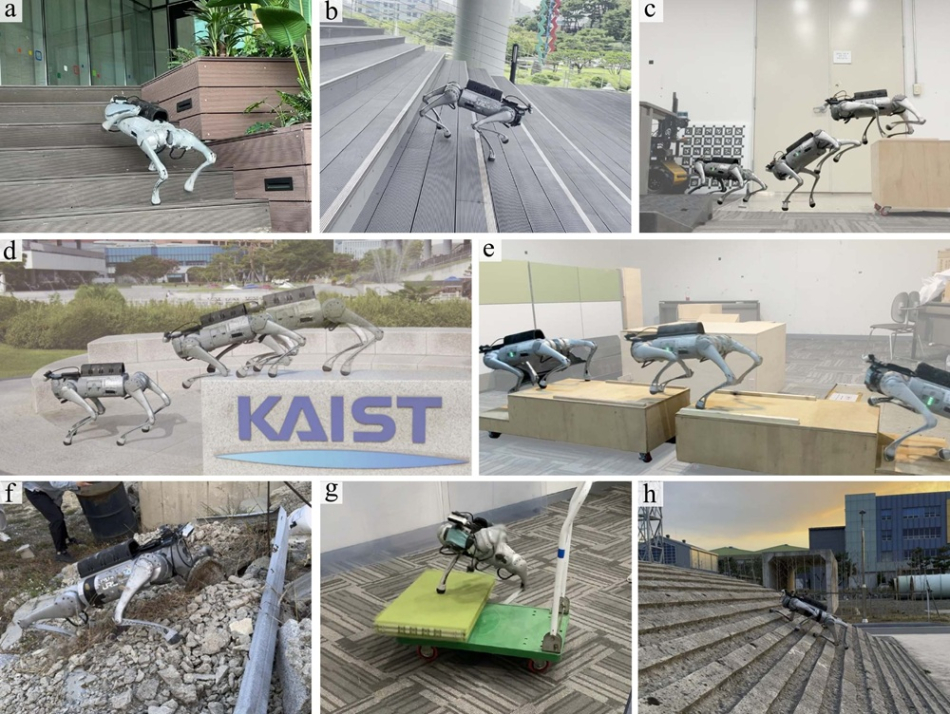

드림워크++는 이 한계를 보완해 내부 감각에 더해 시각기반 외부 감각을 결합해 장애물을 사전 인지하고, 충돌 이전에 보행 방식을 바꾸도록 설계한 ‘인지형 보행’이 핵심이다.

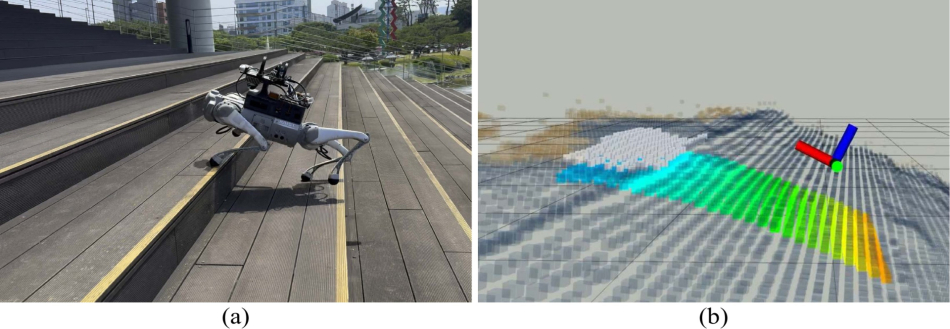

이 기술을 탑재한 로봇은 50개 계단으로 구성된 구간을 35초 만에 통과하며 기존 제어 방식보다 빠른 속도를 기록했다.

또 학습 조건보다 훨씬 가파른 35도 경사에서도 안정적으로 이동했고, 자세를 능동적으로 조정해 구동효율까지 개선했다.

장애물 대응 능력도 강화됐다.

실험 결과 별도 경로설정 없이 상황에 맞는 이동 경로를 스스로 선택했고, 낙차가 불확실한 구간에서는 일시 정지 후 지형을 탐색해 행동했다.

특히 2.5kg 물체를 싣고 장애물을 넘는 등 민첩성도 입증했다.

또 연구팀은 다중 감각 정보를 통합하는 강화학습 구조를 적용해 연산 부담을 낮추면서도 실시간 제어가 가능하도록 했다.

이를 통해 센서 일부가 작동하지 않는 상황에서도 다른 감각 체계로 전환해 보행을 이어갈 수 있도록 설계했다.

이 기술은 사족보행 로봇뿐 아니라 휴머노이드, 휠-족형 로봇 등 다양한 형태로 확장 적용이 가능하다.

연구팀은 이 기술이 재난현장, 산업시설 점검, 산림농업 등 기존 바퀴형 장비로 접근이 어려운 환경에서 활용도가 클 것으로 전망했다.

명 교수는 “로봇이 단순 이동을 넘어 주변을 인식하고 스스로 판단하는 수준으로 발전했다”며 “현장 적용이 가능한 지능형 이동 기술로 확대할 계획”이라고 말했다.

한편, 이번 연구에는 이마데 아스윈 나렌드라 박사(크프톤)가 제1저자로, 유병호 박사(유로보틱스 CEO), 오민호 박사(유로보틱스 CTO), 이동규(유로보틱스 CTO), 이승현(KAIST), 이현우(KAIST), 임형태 박사(MIT 박사후연구원)가 공동저자로 참여했다.

연구결과는 지난 2월 국제학술지 ‘IEEE Transactions on Robotics’에 게재됐다.

(논문명: DreamWaQ++: Obstacle-Aware Quadrupedal Locomotion With Resilient Multi-Modal Reinforcement Learning)