KAIST가 인공지능(AI)의 '과도한 확신(Overconfidence)’을 줄여 모르는 것을 스스로 인식하도록 만드는 학습 기술을 제시해 주목받고 있다.

KAIST 뇌인지과학과 백세범 석좌교수팀은 AI가 모르는 상황을 스스로 인식록 학습해 과도한 확신을 줄이고 신뢰성을 높이는 기술을 개발했다.

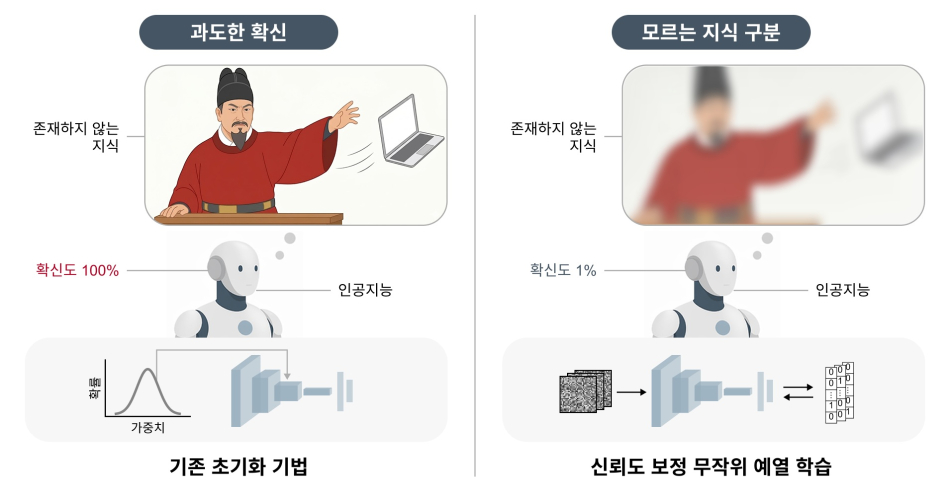

딥러닝 기반 AI는 틀린 예측에 대해서도 높은 확신을 보이는 과도한 확신 현상을 보이며 자율주행이나 의료 진단 등 안전이 중요한 분야에서 위험 요소로 지적받았다.

이런 현상은 생성형 AI가 존재하지 않는 정보를 그럴듯하게 만들어내는 환각(Hallucination) 문제로 이어진다.

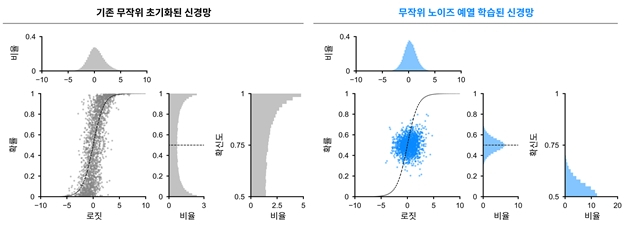

이에 연구팀은 신경망 학습 시작 시 가중치를 확률 분포에 따라 무작위로 설정하는 '무작위 가중치 초기화(Random weight initialization)'가 AI 과신의 근본 원인임을 규명했다.

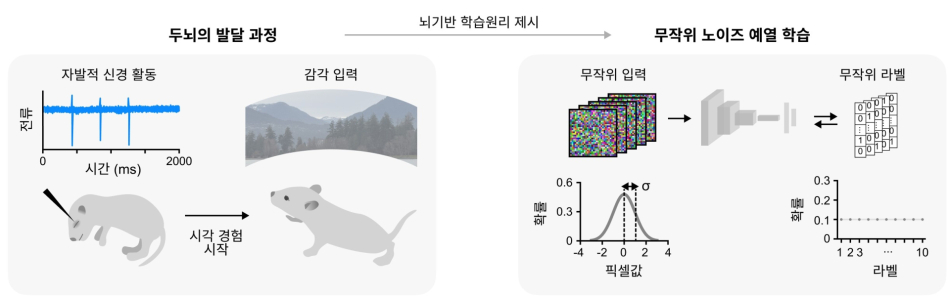

연구팀은 실제 아무것도 배우지 않은 초기 상태의 신경망에 임의의 데이터를 입력해도 높은 확신도를 보이는 현상을 확인하고, 이에 대한 해결책을 생물학적 두뇌 발달 과정에서 찾았다.

인간 두뇌는 태어나기 전 외부 자극이 없는 상태에서도 스스로 뇌 신호를 만드는 자발적 신경 활동을 통해 신경회로를 형성하고 미세 조정한다.

연구팀은 이 개념을 인공신경망에 적용해 실제 학습 전 무작위 노이즈 입력을 이용, 신경망을 짧게 학습시키는 노이즈 예열 학습 전략을 제안했다.

노이즈 예열 과정을 거친 AI 모델은 초기 확신도를 우연 수준의 낮은 값으로 정렬해 기존 초기화 방식의 과신 편향을 완화했다.

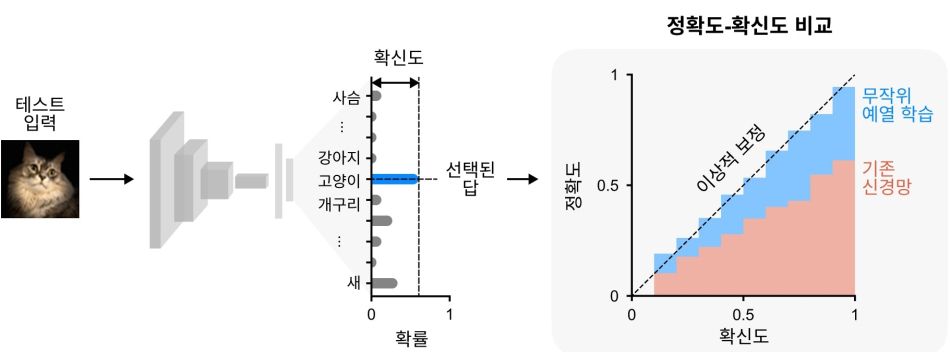

실제 데이터를 배우기 전에 '아무것도 모르는 상태'를 먼저 학습해 예측 정확도와 스스로 맞다고 믿는 '확신도'를 일치하도록 개선했다.

특히 처음 보는 데이터에 대해 확신도를 낮춰 '모른다'고 판단하는 능력을 높였다.

이를 통해 훈련에 사용하지 않은 새로운 유형의 데이터를 구분하는 분포 밖 데이터 탐지에서도 높은 성능을 보였다.

이번 연구는 AI가 단순히 정답을 맞히는 것을 넘어 자신의 인지 상태를 스스로 인식하는 '메타 인지(Meta-cognition)' 능력을 갖출 가능성을 제시한 것으로, 생성형 AI처럼 높은 신뢰성을 요구하는 분야 전반에 활용될 전망이다.

백 석좌교수는 "이번 연구는 두뇌 발달 과정을 모사해 AI가 인간과 유사하게 지식 상태를 인식할 수 있음을 보여준 사례"라며 "정확도를 높이는 수준을 넘어 스스로 불확실성을 판단하는 원리를 제시했다는 데 의의가 있다"고 설명했다.

한편, 이번 연구는 KAIST 뇌인지과학과 천정환 석사가 제1저자로 참여했고, 연구결과는 지난 9일 국제학술지 '네이처 머신 인텔리전스(Nature Machine Intelligence)'에 게재됐다.

(논문명: Brain-inspired warm-up training with random noise for uncertainty calibration)

![[쿠키과학] ‘많을수록 더 균일해진다’… KAIST, 나노입자 상식 뒤집어](/data/kuk/image/2026/05/08/kuk20260508000056.jpg)

![[쿠키과학] 생명연 "유해조류 독성, 개체 수 아닌 성장 단계가 좌우"](/data/kuk/image/2026/05/07/kuk20260507000153.jpg)